Il MIDI: Guida introduttiva

PREMESSA

Siamo giunti ormai al nostro quinto appuntamento con il mondo della produzione musicale, affrontando assieme diverse tematiche sia di carattere tecnico, che storico ed artistico.

Con il presente articolo si va a chiudere il primo modulo didattico che racchiude LE BASI, ossia tutto ciò che dovete conoscere, e di cui dovreste avere la più completa padronanza per progredire autonomamente nella produzione musicale muovendovi con efficacia, e per ottenere dei risultati concreti sia dalle mie successive lezioni che dal vostro lavoro.

Prima di addentrarci nell’argomento di oggi, trovo dunque che questo sia un ottimo momento per fare un breve primo riepilogo degli argomenti che abbiamo visto assieme in questo viaggio; desidero inoltre ringraziare Makers Of Underground Music, i miei allievi e tutti i miei follower, che dall’inizio di questo viaggio rappresentano una famiglia sempre più presente e numerosa.

INTRODUZIONE

- Nel primo capitolo si è parlato di DAW, analizzando nello specifico le principali caratteristiche di ogni software di produzione musicale, attraverso anche frequenti confronti con l’universo analogico;

- nel secondo capitolo si è parlato di MUSICA ELETTRONICA, intesa come tutta la musica prodotta e/o manipolata prevalentemente mediante l’uso di strumentazione elettronica, approfondendo le principali caratteristiche dell’audio digitale e le basi dell’arrangiamento dalla prospettiva di un producer;

- nel terzo capitolo si è parlato di MICROFONI: li abbiamo esaminati e classificati secondo caratteristiche costruttive e di utilizzo pratico, abbiamo parlato di risposta in frequenza, dell’interessante “effetto di prossimità”, di figure polari e quindi di direttività, dispensando poi una serie di consigli utili sia all’uso che all’acquisto del microfono ideale per le proprie esigenze;

- nel quarto capitolo si è parlato delle FASI DELLA PRODUZIONE MUSICALE, attraverso anche considerazioni e consigli di carattere personale e etico, oltre che artistico e pratico: una panoramica dell’intero percorso che inizia dalla nascita di un’idea musicale e termina con la sua concretizzazione nel “prodotto”, passando per le fasi di registrazione, editing, missaggio e finalizzazione o mastering.

L’argomento di oggi è il MIDI, anello di congiunzione fra gli articoli citati, nonché materia di cui è fondamentale avere massima padronanza per trarre il massimo dalla nostra creatività e dagli strumenti di cui disponiamo.

Trattandosi di un importante capitolo nella storia della musica e degli strumenti musicali, non solo per chi ne ha vissuto gli albori, ma anche per tutti i musicisti nati negli anni seguenti e che oggi sono inconsapevolmente immersi nel MIDI, è bene conoscerne anche le origini.

CENNI STORICI SUL MIDI

Tra la fine degli anni 70 e l’inizio degli anni 80, fattori come il boom di popolarità dei sintetizzatori, l’avvento e la crescente diffusione dei sistemi digitali, spinsero il mercato a sviluppare nuove soluzioni per garantire l’interfacciabilità degli strumenti musicali.

I principali costruttori di strumenti musicali si discostarono quindi dal precedente sistema di controllo analogico CV/Gate, per sviluppare nuove soluzioni di controllo.

Ben presto, però, si comprese che la mancanza di compatibilità tra strumenti di costruttori diversi sarebbe stata un importante ostacolo, sia per il mercato che, ovviamente, per i musicisti:

questo pensiero è alla base della nascita del MIDI, che vide ufficialmente la luce nel 1983, per merito dei padri fondatori Dave Smith (Sequential Circuits), “Taro” Kakehashi (Roland) e Tom Oberheim (Oberheim Electronics).

MUSICAL INSTRUMENT DIGITAL INTERFACE

Con l’acronimo MIDI (Musical Instrument Digital Interface) si indica il protocollo di comunicazione tra strumenti musicali più diffuso al mondo, le cui applicazioni vanno ben oltre la digitalizzazione di una performance eseguita su un controller.

Attraverso il MIDI è possibile connettere fra loro due o più synth e/o moduli sonori e sommarne le timbriche (tecnica del layering) per creare tappeti sonori particolarmente ricchi e suggestivi, ma anche controllare a distanza le funzioni di un Software Instrument o le funzioni di base di una DAW e di un mixer MIDI compatibile, così come è altresì possibile sincronizzare due o più macchine (es. Ableton Live attivo su due differenti computer di cui uno è detto Master e uno è detto Slave), richiamare le patch di un multieffetto, mandare in play sequenze live sul palco, far variare automaticamente lo stato di uno o più strumenti musicali a un dato punto delle suddette sequenze, controllare le luci di scena con un’interfaccia MIDI-DMX a ritmo di musica e molto altro…

(Un’insolita M-Audio KeyStation 49e dal look post-apocalittico, realizzata artigianalmente dall’autore, per suonare la chitarra in live looping con Ableton Live gestendo la DAW con l’uso dei piedi – Fonte: Mario Inghes)

(Un’insolita M-Audio KeyStation 49e dal look post-apocalittico, realizzata artigianalmente dall’autore, per suonare la chitarra in live looping con Ableton Live gestendo la DAW con l’uso dei piedi – Fonte: Mario Inghes)

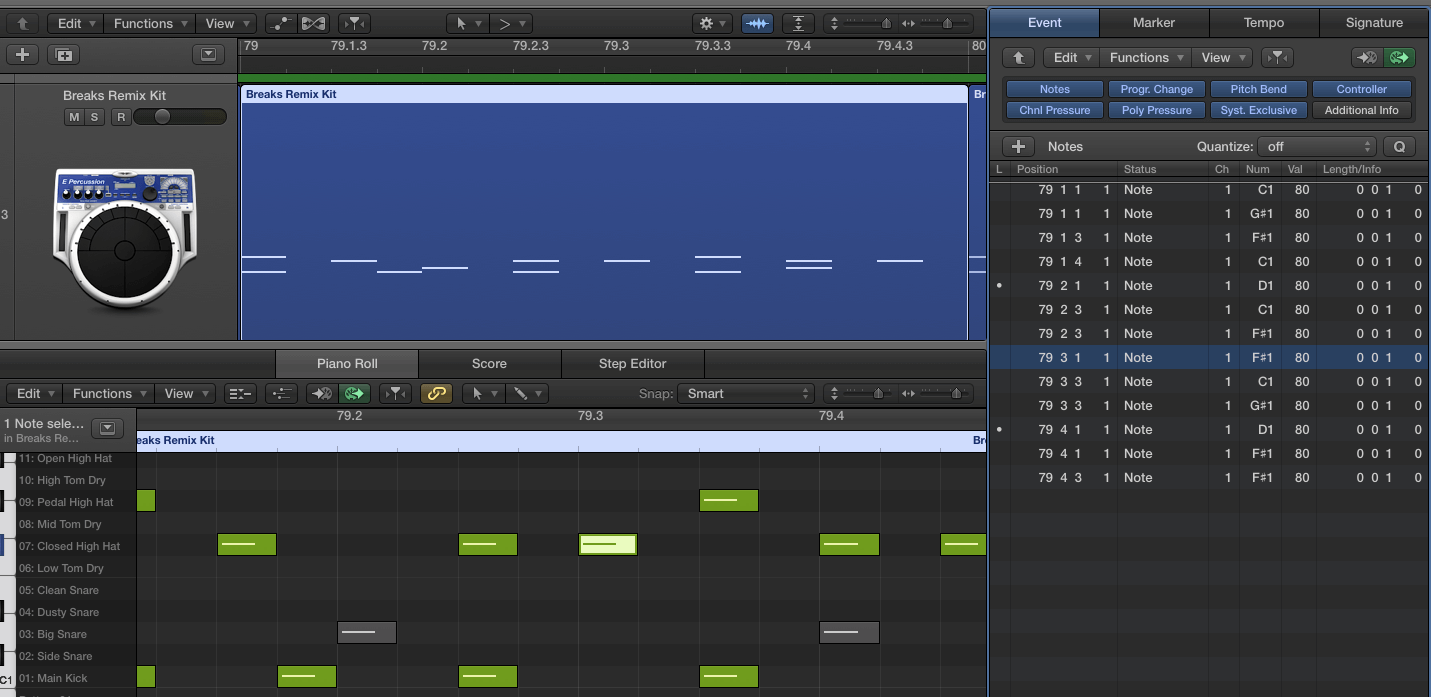

Trattandosi di istruzioni digitali, ogni evento MIDI può essere anche registrato, modificato e ritrasmesso a piacimento. Nell’ambito della produzione musicale, ogni performance eseguita su strumenti MIDI viene catturata sotto forma di lista di eventi in linguaggio MIDI, ed eventualmente modificata, il tutto all’interno di una DAW o attraverso un sequencer digitale.

(Piano Roll in basso e List Editor a destra, attivi in DAW Apple Logic Pro X – Fonte: Mario Inghes)

(Piano Roll in basso e List Editor a destra, attivi in DAW Apple Logic Pro X – Fonte: Mario Inghes)

Lo standard di comunicazione MIDI prevede che l’hardware MIDI–compatibile disponga di un’interfaccia in grado di gestire e interpretare correttamente messaggi MIDI, che possono essere ricevuti e trasmessi da/verso altre macchine attraverso un cavo connesso alle seguenti porte fisiche:

- MIDI In, incaricata di ricevere messaggi MIDI da una macchina esterna (come ad esempio un controller, o un sequencer);

- MIDI Out, incaricata di trasmettere messaggi MIDI generati dalla macchina stessa, ad altri dispositivi (ad esempio un synth);

- MIDI Thru, incaricata di ritrasmettere verso altre destinazioni i messaggi in ingresso sulla porta MIDI In.

(Porte MIDI sul retro di una “Roland U-20”, connessa in Slave Mode al computer tramite l’interfaccia MIDI-USB “M-Audio MIDISPORT 2×2 Anniversary Edition” – Fonte: Mario Inghes)

(Porte MIDI sul retro di una “Roland U-20”, connessa in Slave Mode al computer tramite l’interfaccia MIDI-USB “M-Audio MIDISPORT 2×2 Anniversary Edition” – Fonte: Mario Inghes)

Nel caso di hardware MIDI-USB, i messaggi in ingresso e in uscita sono sempre messaggi in linguaggio MIDI, ma viaggiano attraverso un unico cavo, appunto, USB; è il caso dei moderni controller concepiti per la computer music, anche se oggigiorno quasi tutti gli apparati MIDI-compatibili in commercio dispongono anche di una porta USB.

(Porte MIDI In e USB sul retro dei Doepfer Dark Energy I e II – Fonte: Mario Inghes)

(Porte MIDI In e USB sul retro dei Doepfer Dark Energy I e II – Fonte: Mario Inghes)

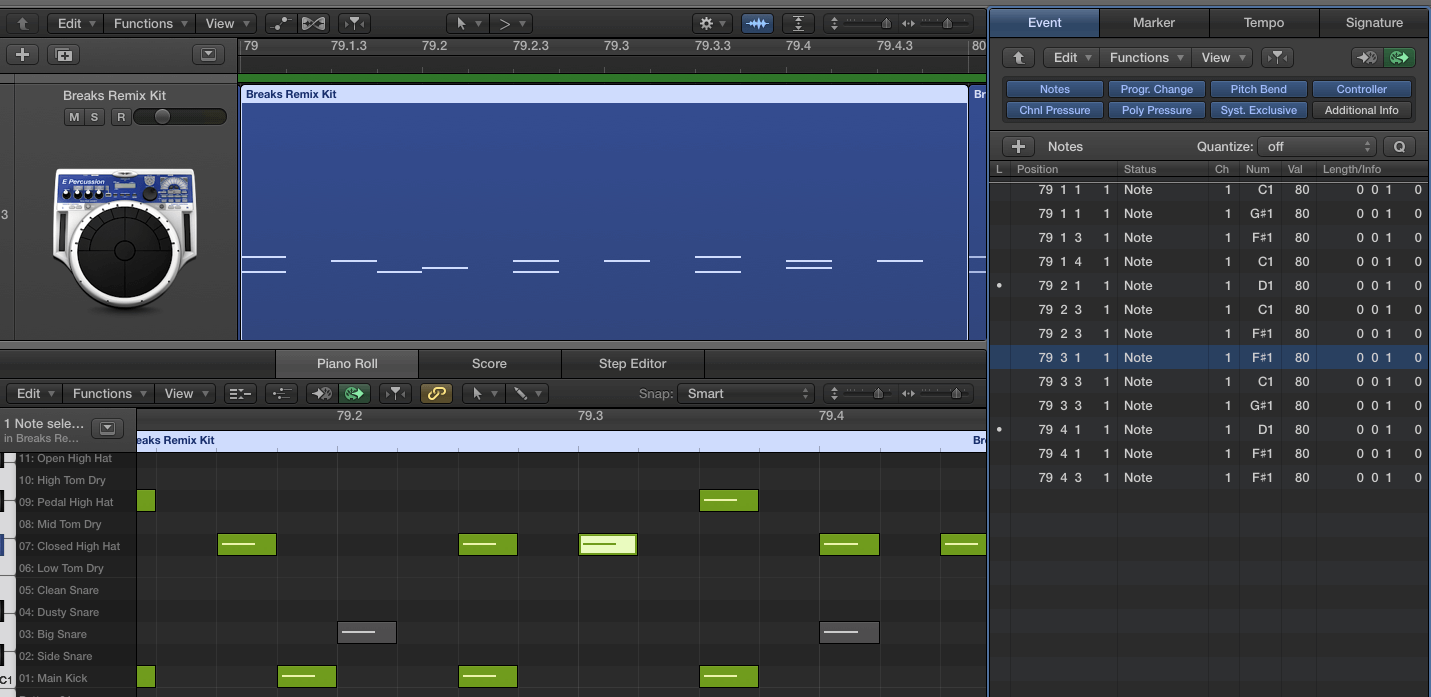

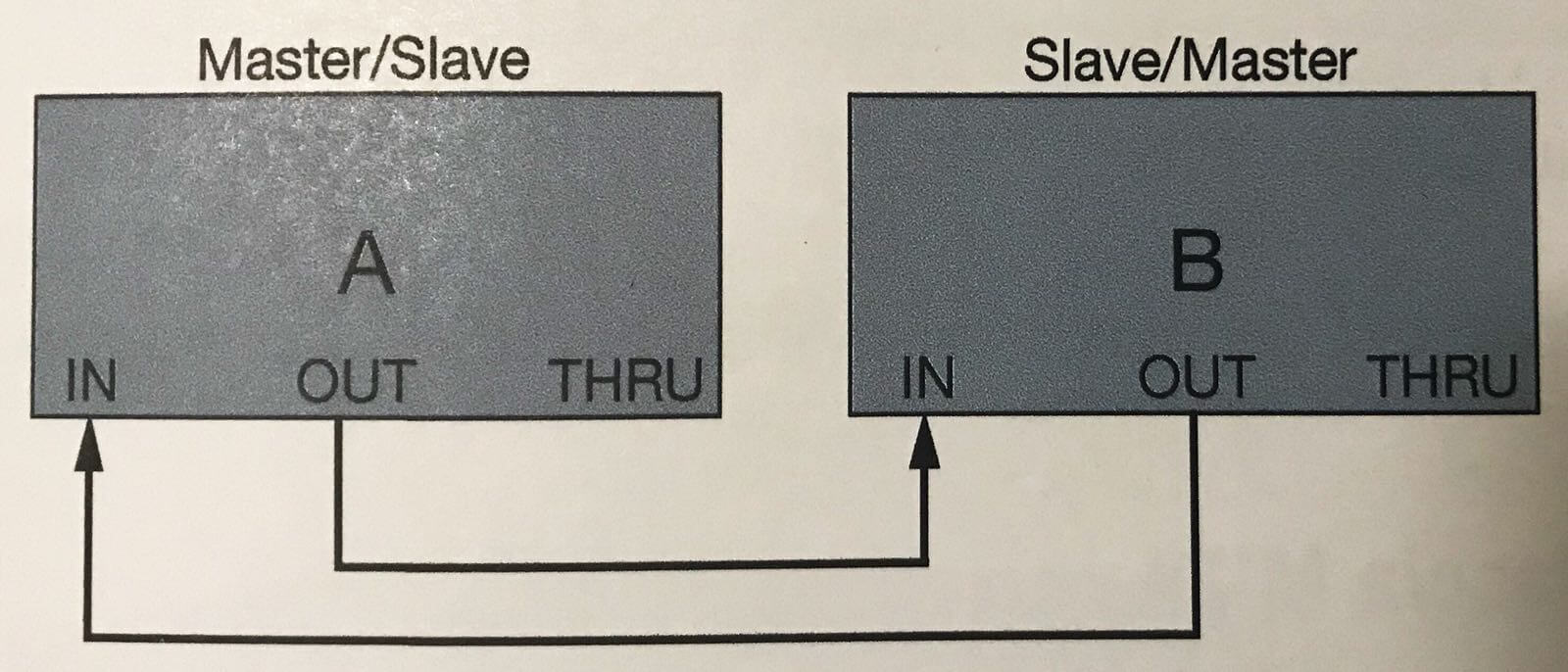

Vediamo ora alcuni schemi di connessione tra apparati MIDI:

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

La macchina A, definita Master, controlla la macchina B, definita Slave. È il tipico caso in cui, con una tastiera o un altro tipo di controller MIDI (A) suoniamo un synth, un expander, o un software instrument installato nel nostro computer (B).

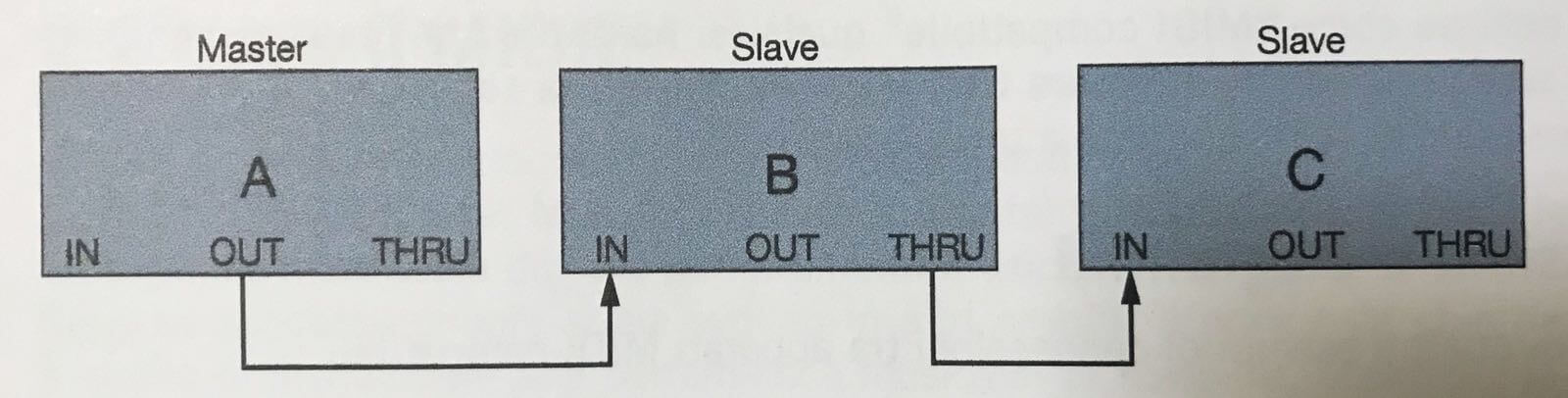

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

La macchina A controlla la macchina B, e la macchina B controlla la macchina A: sono entrambe pertanto sia Master, che Slave; è bene ricordare che dalla porta Out di ciascuna macchina passano solo messaggi generati dalla macchina stessa. Questo è il tipico caso dei controller studiati per Ableton Live, sebbene dotati di connessione MIDI-USB: il controller (A) pilota Ableton Live (B), e quest’ultimo pilota il controller, sul quale vedremo i pad cambiare colore e illuminazione in relazione allo stato delle clip su Ableton Live (“rec”, “play”, “stop”) o cambiare logica, adattandosi a rappresentare un’altra istanza di controllo dell’ambiente di Live (controlli di mixing, etc.), affinché si possa controllare l’intera DAW senza quasi mai distogliere lo sguardo dal controller o mettere mano al computer.

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

In questo terzo caso, la macchina A controlla sia la macchina B che la macchina C.

I messaggi in uscita dalla MIDI Thru della macchina B verso la macchina C sono una ripetizione dei messaggi in ingresso alla MIDI In dell’apparato B e in arrivo dall’Out della macchina A, non sono pertanto generati dalla macchina B, ma da A.

Questo è il caso in cui con una tastiera, o un sequencer, controlliamo due synth, ma anche il caso in cui, mediante una pedaliera MIDI (apparato A) io, chitarrista, scelga di cambiare contemporaneamente sia i settaggi del mio pre-amplificatore B (es. da suono distorto a suono pulito), che del mio multieffetto C (es. passaggio da una patch di leggero riverbero plate, a una patch di chorus, delay e riverbero hall).

(Patch n.3 attiva su Rocktron Piranha, pre-amplificatore MIDI-compatibile per chitarra – Fonte: Mario Inghes)

(Patch n.3 attiva su Rocktron Piranha, pre-amplificatore MIDI-compatibile per chitarra – Fonte: Mario Inghes)

È bene sapere che, trattandosi di una connessione seriale, vi è una latenza di risposta tra B e C dell’ordine di pochi millisecondi: in altre parole, C risponderà (o suonerà) alcuni millisecondi in ritardo rispetto a B.

Nella maggior parte dei casi questo dato è trascurabile, ma può rappresentare un inconveniente nel caso, ad esempio, di layering di parti timbriche operanti su range di frequenze in cui un ritardo tra gli apparati potrebbe causare udibili problemi di fase; ove non trascurabili, essi sono risolvibili applicando un delay time al modulo generatore (se la macchina consente ciò) o all’uscita audio della macchina B, per allinearla alla macchina C.

Tuttavia, è facile immaginare che, se avessimo una catena di molti più apparati, il ritardo non sarebbe più limitato a un unico step, ma a tanti step quanti sono gli apparati, pertanto tutte le macchine sarebbero sfasate tra loro, e l’ultima della catena si troverebbe a suonare in netto ritardo rispetto alla prima. Ciò è inconcepibile, ma la soluzione c’è e si chiama THRU BOX:

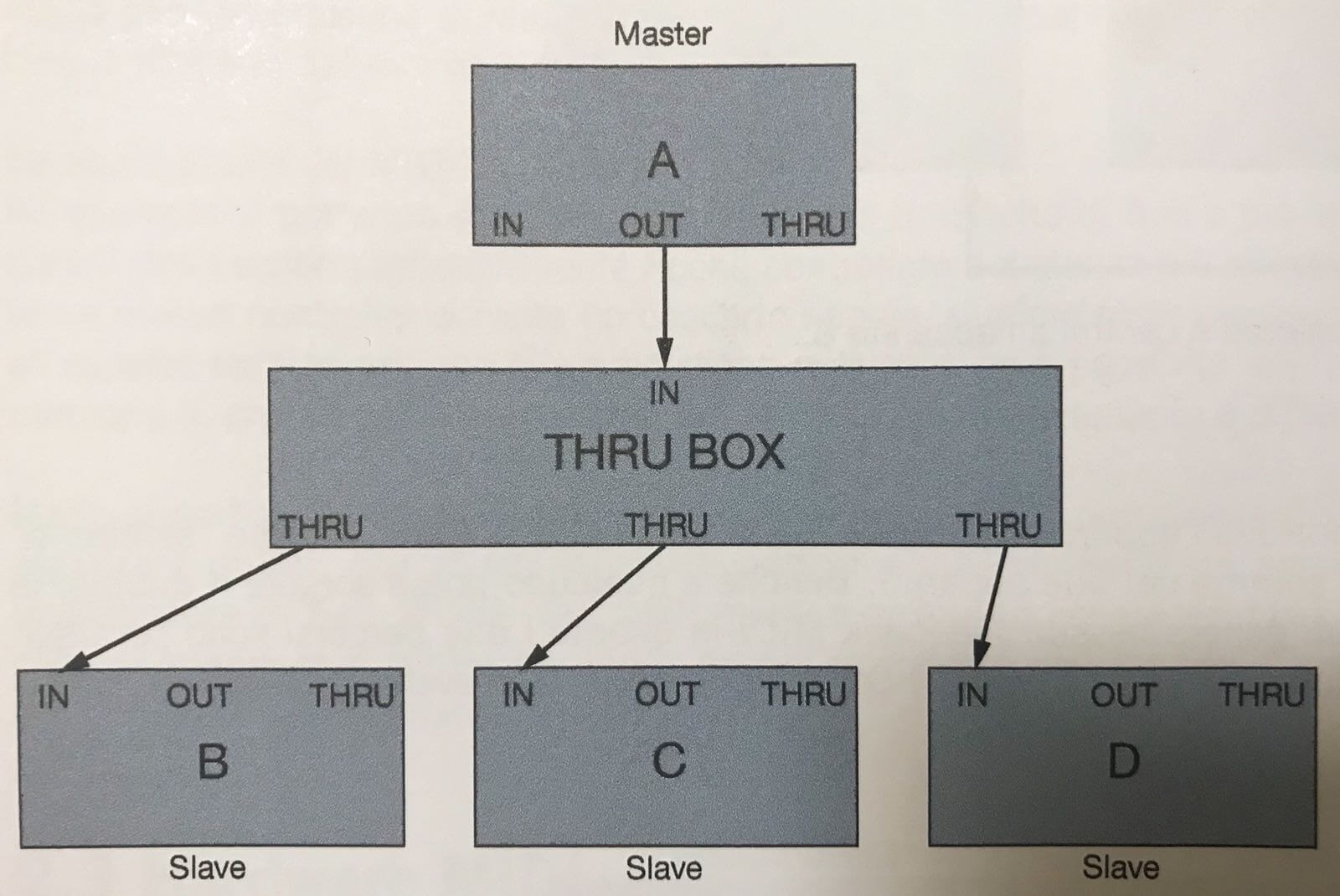

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

(Immagine tratta dal libro “La produzione musicale con Logic Pro X”, di Alessandro Magri – Audio Engine Music)

Grazie alla THRU BOX, abbiamo potuto attuare una connessione parallela degli apparati, pertanto la latenza di risposta è limitata a un unico step, dopodiché B, C e D riceveranno i messaggi MIDI nello stesso preciso istante.

LINGUAGGIO E TIPOLOGIE DI MESSAGGI MIDI

Lo standard MIDI prevede che i messaggi siano divisi in gruppi di tipologie; la tipologia che descrive la nostra performance in messaggi digitali MIDI è detta Channel Voice Messages.

I Channel Voice Messages si dividono in:

- Pitch Bend: riguarda le variazioni di intonazione per mezzo della “Pitch Wheel” sul controller, dette anche “bending”;

- Program Change: attraverso i messaggi Program Change è possibile richiamare una particolare Patch assegnata a un dato canale nel sintetizzatore, direttamente agendo sul controller;

- Key Pressure/Channel Pressure: parametro descrittivo della pressione ulteriormente esercitata su un tasto DOPO che esso è stato schiacciato (Aftertouch): in base alla quantità di pressione è possibile variare uno o più comportamenti del synth, ma generalmente si usa per controllare l’intensità del “vibrato”; il Key Pressure (o Poly Aftertouch) è polifonico, ossia permette che l’azione sia circoscritta alla nota premuta, mentre il Channel Pressure estende il variare di pressione di un tasto anche a tutte le altre note suonate in quel momento.

- Note Messages: traducono l’azione della pressione dei tasti in un codice descrittivo rispettivamente della avvenuta pressione (Note On), del tasto premuto (Note Number 0-127), della forza con cui il tasto è stato premuto (Note Velocity 1-127) e del rilascio del tasto (Note Off, o Note Velocity = 0).

- Control Change: descrivono numericamente tutte le azioni diverse dalla pressione dei tasti, come ad esempio il movimento di un knob, o di una wheel; ciascuna azione può essere programmata a piacimento per il controllo di una o più specifiche funzioni della macchina ricevente (controlli ADSR, volume, filtri, pan, pedale sustain, etc…);

(Pitch Bend e Modulation Wheel su controller Samson Graphite 49 – Fonte: Mario Inghes)

(Pitch Bend e Modulation Wheel su controller Samson Graphite 49 – Fonte: Mario Inghes)

Nel linguaggio MIDI, il range di variazioni di ciascun parametro è compreso in una scala di valori che va da 0 a 127; nella programmazione avanzata dei controller MIDI è possibile ridurre o invertire il range, ma ogni performance verrà sempre digitalizzata con una profondità di 7 bit, pertanto si avranno a disposizione 128 possibili valori.

Quasi tutti gli strumenti MIDI odierni hanno però specifiche nettamente superiori a quelle che il protocollo MIDI originario riuscirebbe a gestire, basti pensare alla quantità di Patch memorizzabili al loro interno, o all’interno di un computer, che può ospitarne ben più, delle 128 richiamabili via Program Change, in base alle specifiche delle interfacce MIDI concepite originariamente.

Per aggirare la limitazione dei 7 bit, alle specifiche delle interfacce moderne sono stati aggiunti i messaggi di MSB e LSB; poiché questo articolo non vuole essere un trattato di ingegneria informatica, ci basterà sapere che, grazie a questa accortezza, i controller di oggi dispongono di un adeguato sistema di selezione dei Banks, e che ciascun Bank contiene 128 Patch; il numero di banchi accessibili e patch richiamabili è pertanto definito solo dalle potenzialità del sintetizzatore.

Le altre tipologie di messaggi MIDI riguardano il comportamento dell’apparato, la logica con cui filtra (o non filtra) i messaggi (selettività per canale o modalità Omni/All), possibilità di reset, polifonia, Panic Mode, sincronizzazione SMPTE > MTC e operazioni esclusive di gestione di sistema.

Sebbene queste altre tipologie ci interessino meno, è bene spendere due parole sul Panic Mode, perché potrebbe salvarci da una brutta situazione:

può accadere che alcuni messaggi MIDI non vengano sempre ricevuti correttamente, e dunque, per esempio, che un messaggio di Note Off si perda per strada, causando che una o più note continuino a suonare all’infinito anche dopo che tutti i tasti sono stati rilasciati.

Il Panic Mode fa parte dei messaggi della tipologia Channel Mode Messages e invia un “All Notes Off” al synth che, di risposta, ferma tutte le note; prima di salire su un palco con degli strumenti MIDI sarebbe dunque opportuno documentarsi su quale sia la combinazione di tasti da premere sul proprio controller per attivare il Panic Mode; spegnere e riaccendere non è la soluzione consigliabile… siete avvisati.

Lo standard MIDI prevede inoltre la possibilità di inviare messaggi MIDI verso sedici canali indipendenti e separati fra loro: fatta eccezione per i messaggi di sistema (SysEx, etc), che viaggiano sempre su tutti i canali, dobbiamo sapere che i Channel Voice Messages possono essere indirizzati verso canali singoli, e la comprensione di questa logica introduce al concetto di multitimbricità.

MULTITIMBRICITÀ

Supponiamo di avere un sintetizzatore capace di una multitimbricità di tre parti, ossia un sintetizzatore capace di suonare con tre diversi timbri contemporaneamente, per esempio un basso, un pianoforte e un pad;

supponiamo poi di avere un sequencer, o una DAW, tramite cui vorremmo inviare la linea di basso SOLO alla parte di basso, la partitura di piano SOLO alla parte di piano, e la partitura di pad SOLO alla parte di pad.

Affinché quest’arrangiamento sia rispettato, sarà necessario:

- impostare il sintetizzatore in modo che la parte di basso accetti la ricezione di eventi MIDI esclusivamente dal canale 1, quella di piano esclusivamente dal canale 2 e quella di pad esclusivamente dal canale 3;

- impostare il sequencer in modo che la partitura di basso venga trasmessa esclusivamente al canale 1, quella di piano esclusivamente al canale 2 e quella di pad esclusivamente al canale 3.

NOTA: non è essenziale che i canali siano per forza 1, 2 e 3 come da esempio, ciò che conta è che corrispondano sia nell’apparato ricevente che nell’apparato trasmittente; tuttavia, solitamente, al canale 10 si fa corrispondere una drum machine.

L’impostazione dei canali MIDI serve dunque per regolare la logica di trasmissione e ricezione tra gli apparati.

Se volessi invece, con un’unica tastiera MIDI, ottenere un suono composto dai tre diversi timbri, dovrei impostare il sintetizzatore (o un software instrument, se l’apparato ricevente fosse un computer) in modo che tutte e tre le parti ricevano dallo stesso canale, che deve (ovviamente) essere quello a cui la tastiera trasmette, o non sentirei alcun suono.

POLIFONIA

Similmente alla multitimbricità, la polifonia esprime un’altra capacità del sintetizzatore, che è quella di poter riprodurre più voci contemporaneamente, ed è importante sapere che la polifonia si esprime in rapporto sia alla multitimbricità che alle note suonate.

Nel caso che ho descritto sopra, in cui con un’unica tastiera faccio suonare contemporaneamente tre diversi timbri al synth, ad ogni nota premuta sulla tastiera corrispondono TRE voci.

Un accordo a due mani in questa condizione corrisponde quindi all’impiego di trenta voci (dieci dita per tre timbri).

Se mantengo l’accordo con il pedale di sustain, e con le mani suono altre note, per ciascuna di quelle note suonata corrispondono sempre tre voci, più le trenta iniziali che sto ancora mantenendo con il pedale di sustain.

È facile quindi intuire che il synth (o il software instrument) deve avere una capacità polifonica adeguata all’utilizzo che il musicista intende farne; qualora si superi il limite di voci previste, al suonare di nuove note, le prime vengono fermate (Note Off), ciò non è sempre carino da sentire.

IL MIDI PER I BATTERISTI (Triggering & Drum Replacement)

TRIGGERING

Essendo la batteria acustica uno strumento complesso da riprendere, registrare ed eventualmente editare, molti batteristi, tecnici del suono e produttori adottano nel proprio lavoro la tecnica del triggering, parallelamente o in sostituzione parziale/totale della microfonazione.

Per mezzo di particolari trasduttori, detti trigger, che si installano su una o più zone dei fusti e sovente anche sui piatti, e per mezzo di una particolare interfaccia MIDI dedicata, è possibile digitalizzare la performance del batterista sotto forma di eventi MIDI che vengono poi trasmessi a un modulo sonoro, a una centralina o a un Virtual Drum Kit, che ad ogni colpo riproduce un campione audio dal suono perfetto, o a un sequencer che registra ogni singolo evento.

La registrazione della batteria con questa tecnica permette una grande facilità di lavoro e flessibilità pressoché del 100% in fatto di editing e di scelta molto accurata dei suoni, ma non è esente da problemi: se la sensibilità di un trigger è eccessiva, o se esso è montato male o è montato su un set-up di batteria scadente, con evidenti carenze dal punto di vista meccanico, può captare la vibrazione dei fusti adiacenti (bleeding) e falsare la performance.

Agli albori di questa tecnica, le performances di batteria triggerata risultavano piuttosto sterili e fredde, senza feel umano; oggi, anche il “producer pack” più economico ha al suo interno campioni audio di altissima qualità, centinaia di suoni divisi per ripresa microfonica, room, genere, caratteristiche del fusto e addirittura per dinamica (Note Velocity), ed è davvero impossibile non trovare il sound giusto per rendere una sezione ritmica triggerata assolutamente credibile, calda e realistica.

Tuttavia, in alcuni generi musicali come ad esempio il Death Metal, che la ritmica sia letteralmente disumana e glaciale è una scelta vera e propria di produzione artistica.

Con cognizione di causa e particolare attenzione alla fase dei suoni, si possono ottenere dei risultati grandiosi, sia in termini di feeling, che in termini di sound, miscelando (blending) il suono della ripresa microfonica con il suono del campione triggerato, fino a creare sonorità davvero uniche.

DRUM REPLACEMENT

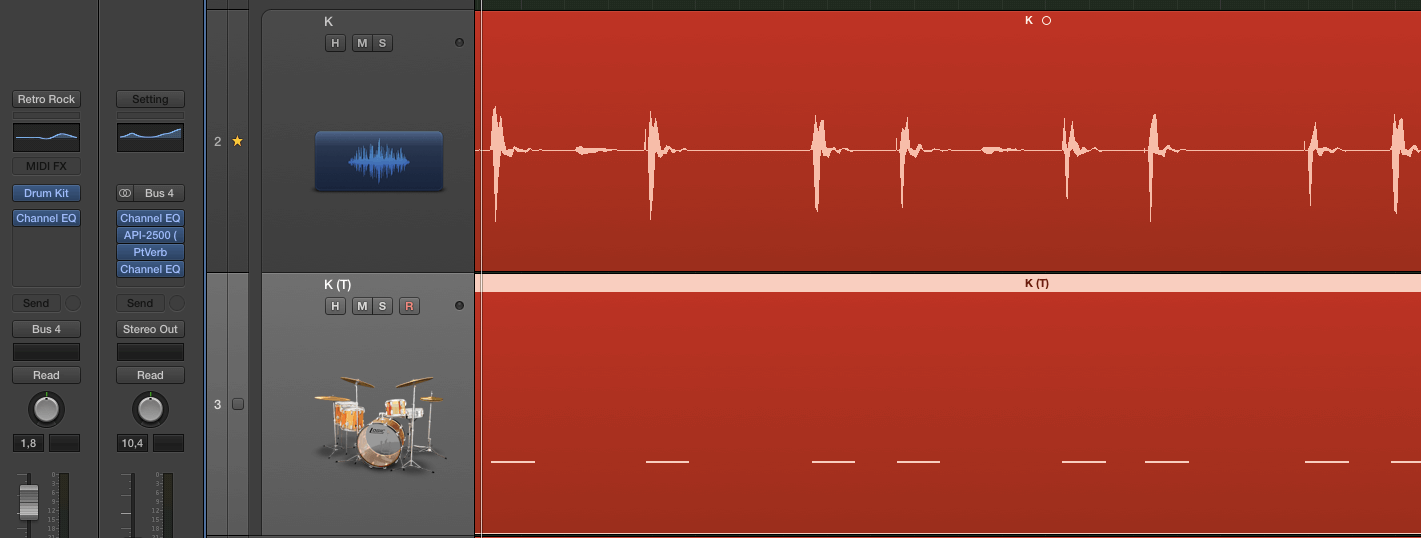

Il drum replacement è una tecnica di triggering “offline” che sfrutta un algoritmo di riconoscimento dei picchi di una traccia audio, per creare una partitura MIDI i cui eventi corrispondono, per posizione (punto di Note On) e dinamica (Note Velocity), esattamente ai colpi del batterista.

(Summing Stack di Kick contenente la ripresa microfonica “K” e la controparte MIDI “K(T)” ove T sta per Trigger, su DAW Apple Logic Pro X – Fonte: Mario Inghes)

(Summing Stack di Kick contenente la ripresa microfonica “K” e la controparte MIDI “K(T)” ove T sta per Trigger, su DAW Apple Logic Pro X – Fonte: Mario Inghes)

Questa tecnica si utilizza sia a scopo creativo, che a scopo correttivo qualora la ripresa microfonica di batteria che abbiamo tra le mani non sia delle migliori e volessimo sfruttarla per pilotare un Virtual Drum Kit e sostituire totalmente il suono originale, oppure miscelarlo con un campione di qualità (blending).

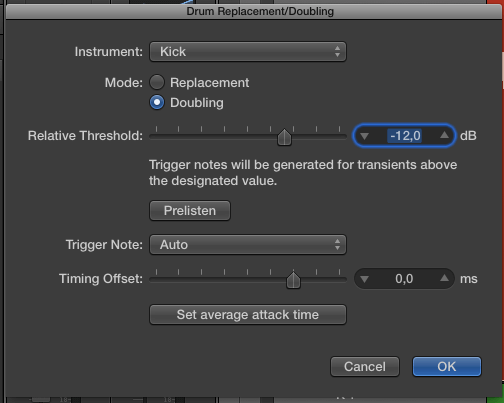

(Funzione di Drum Replacement su DAW Apple Logic Pro X, accessibile dal Menu “Track” o mediante Key Command “ctrl+D” – Fonte: Mario Inghes)

(Funzione di Drum Replacement su DAW Apple Logic Pro X, accessibile dal Menu “Track” o mediante Key Command “ctrl+D” – Fonte: Mario Inghes)

Dal momento che l’algoritmo non fa altro che leggere dei picchi, potremmo, paradossalmente, registrare un intero brano picchiettando con le dita sul microfono integrato del computer, e usare la registrazione per triggerare un sampler con i suoni della batteria degli Slipknot;

provarci è tuttavia meno interessante che immaginare tale possibilità.

CONCLUSIONI

Ad oggi, lo standard MIDI rappresenta la risorsa più completa e importante, nonché quella più a portata di mano, che un musicista, sia esso un neo-producer o un grande artista affermato, possa sfruttare per fare musica: grazie al MIDI è infatti possibile imbastire un’intera orchestra semplicemente con un computer, un mouse e un qualsiasi software sequencer che disponga di un ambiente MIDI adeguato e di un’interfaccia piano roll per il posizionamento intuitivo degli eventi MIDI.

Tuttavia, per capire e sfruttare appieno le infinite potenzialità del MIDI ed entrare veramente nella produzione musicale, è necessario studiare, applicare, sbagliare e sperimentare, in vista anche, perché no, di implementare un giorno, nel proprio arsenale, uno o più sintetizzatori hardware le cui particolari timbriche caratteristiche (spesso date dalle limitazioni dello strumento) hanno fatto la storia della musica.